Nice, Thanks,

J’allais regarder les dependances mais c’est livre pret a l’emploi en plus.

Et la pile logicielle derriere :We follow clean architecture and currently support multiple frameworks and runtimes:

A desktop client with Electron A headless server-mode with Nodejs Planned support for mobile with Capacitor Planned support for Python runtimeOui c’est incroyable, je suis en train de le tester et c’est vraiment bien fichu !

Il s’execute a priori direct sur “garuda linux” pour la version AppImage,

Reste plus qu’a DL les modeles et faire joujou lol,

Les premiers tests sont assez incroyables. Avec le modèle Mistral 7B, sur CPU, la réponse est quasiment aussi rapide que ChatGpt. Un peu moins bonne (qualité). Mais surtout, la dernière version que Mistral 7B essayée à partir de python/transformer, tournait sur le GPU et plantait parfois. La pas de soucis (je n’ai pas fait beaucoup de tests non plus). Sur quelques tests techniques, Mistral 7B se plante allègrement, Mistral 8x7B donne un résultat concis et juste (un peu lent), Mistral 70B rame je n’ai pas attendu le résultat. Clairement à essayer, très simple d’emploi, et à mon avis peut remplacer chatgpt pour des fonctionnalités basiques. Bon par contre je vais tester sur des machines un peu plus basiques avant de conclure.

Merci pour le partage. Ça donne quoi en terme de perfs et de résultats par rapport à gpt4 ? Et on sait quelles sont les données sources ?

En termes de performances, je n’en ai aucune idée. Pour les données, les modèles disponibles sont : https://huggingface.co/models?pipeline_tag=text-generation

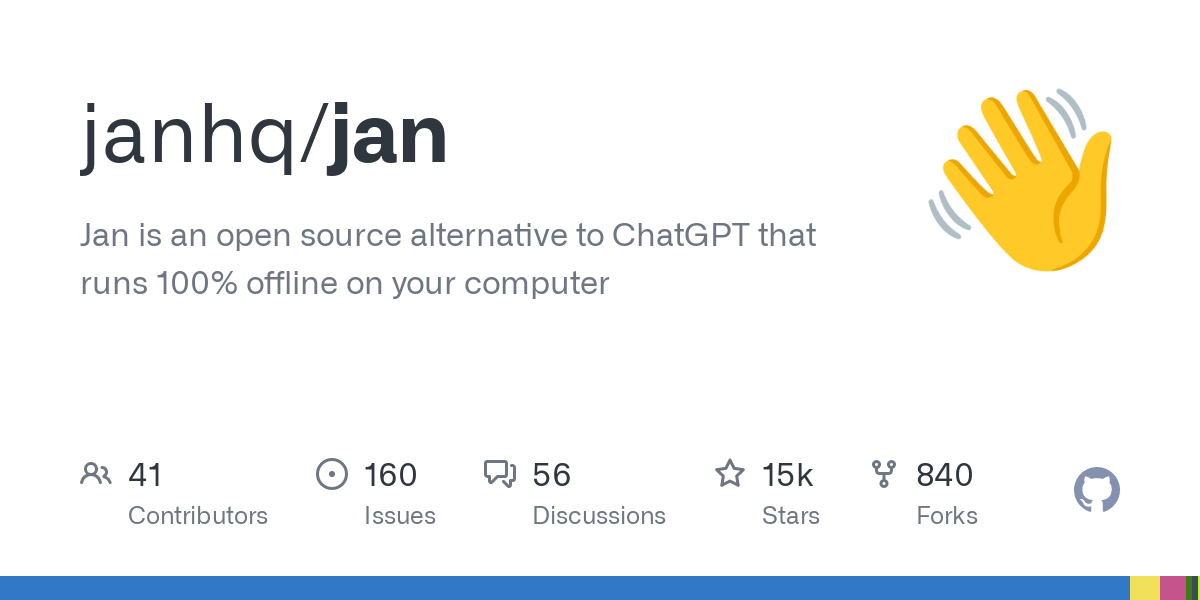

J’avais mal vu mais c’est en fait une interface qui permet d’utiliser des models déjà existant. Je pensais que c’était un model tout court avec une porte d’entrée simple

Super, merci!

Je t’en prie tout le plaisir est pour moi !

Je suis assez déçu de ne pas voir le surpport des GPU AMD, après j’imagine que ce doit être déja assez de boulot de bosser sur CUDA